AI 챗봇은 얼마나 자주 사용자를 위험한 경로로 유도합니까?

[PR]上記の広告は3ヶ月以上新規記事投稿のないブログに表示されています。新しい記事を書く事で広告が消えます。

AI 챗봇은 얼마나 자주 사용자를 위험한 경로로 유도합니까?

이러한 최악의 결과는 비례적으로 상대적으로 드물지만 연구원들은 "AI를 사용하는 사람의 수와 사용 빈도를 고려할 때 매우 낮은 비율이라도 상당한 수의 사람들에게 영향을 미친다"고 지적합니다. 그리고 권한 박탈의 유형에 따라 대화 50분의 1에서 70분의 1 사이에서 발생한 최소한 "경미한" 권한 박탈 가능성이 있는 대화를 고려하면 그 수치는 훨씬 더 악화됩니다.

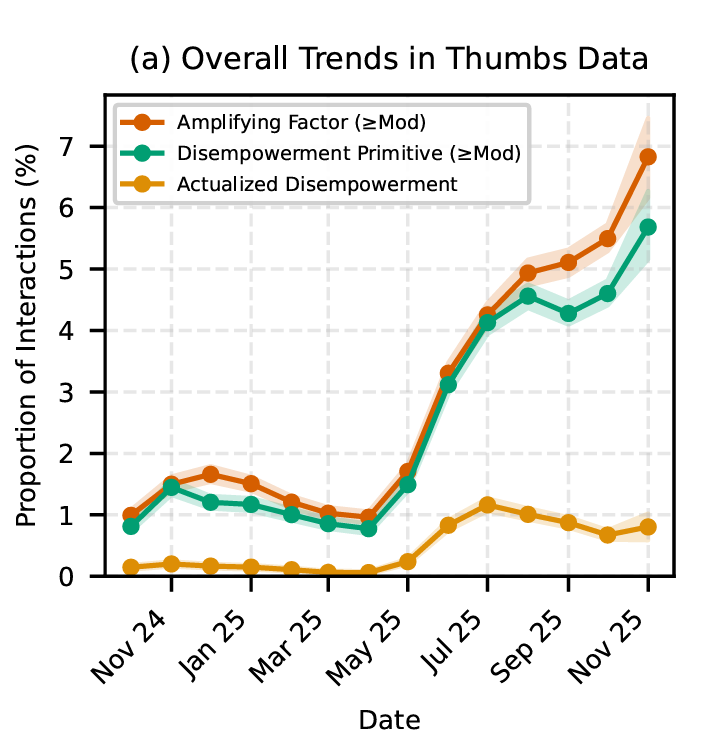

더욱이 Claude와의 대화를 무력화시킬 가능성은 2024년 말부터 2025년 말 사이에 크게 증가한 것으로 보입니다. 연구원들은 이러한 증가의 단일 이유를 밝힐 수는 없었지만, AI가 대중화되고 사회에 통합됨에 따라 사용자가 "취약한 주제에 대해 논의하거나 조언을 구하는 것이 더 편안해지기" 때문일 수 있다고 추측했습니다.

Claude의 응답을 잠재적으로 "무력화"하는 문제는 시간이 지남에 따라 더욱 악화되는 것 같습니다.

Claude의 응답을 잠재적으로 "무력화"하는 문제는 시간이 지남에 따라 더욱 악화되는 것 같습니다.

크레딧: Anthropic

사용자 오류?

연구에서 연구원은 클로드 대화 텍스트 연구는 "확인된 피해보다는 무력화 가능성"만을 측정하며 "본질적으로 주관적인 현상에 대한 자동화된 평가에 의존한다"는 점을 인정했습니다. 이상적으로 그들은 향후 연구에서 사용자 인터뷰나 무작위 대조 시험을 활용하여 이러한 피해를 보다 직접적으로 측정할 수 있다고 썼습니다.

그렇긴 하지만, 이 연구에는 대화 내용이 실제 피해를 분명히 암시하는 몇 가지 문제가 되는 사례가 포함되어 있습니다. Claude는 때때로 격려(예: "확인됨", "정확히", "100%")를 통해 "추측적이거나 위조할 수 없는 주장"을 강화했으며, 이로 인해 어떤 경우에는 사용자가 "현실과 동떨어진 점점 더 정교한 서술을 구축"하게 되었습니다.

Claude의 격려는 사용자가 "대립 메시지를 보내거나, 관계를 끝내거나, 공개 발표 초안을 작성"하는 결과를 가져올 수도 있다고 연구진은 썼습니다. AI가 작성한 메시지를 보낸 사용자들은 나중에 클로드와의 대화에서 “내가 아니었어”, “네가 나에게 멍청한 짓을 하게 만들었어” 등의 표현을 사용하며 후회를 표현하는 경우가 많았다.