tech

-

[PR]

×

[PR]上記の広告は3ヶ月以上新規記事投稿のないブログに表示されています。新しい記事を書く事で広告が消えます。

-

NASA 애니메이션은 유인 달 임무가 어떻게 전개될지 정확하게 보여줍니다.

NASA 비디오(위)는 다가오는 Artemis II 임무가 어떻게 진행될 것으로 예상되는지 매우 자세히 보여줍니다.

우주국이 지난해 애니메이션을 공개했는데 아르테미스 2호 우주비행사가 이르면 2월 6일 달에 갈 수 있다는 점을 보니 다시 봐도 좋은 시점이다.

Artemis II 승무원인 NASA의 Victor Glover, Reid Wiseman, Christina Koch는 캐나다 우주국의 Jeremy Hansen과 함께 강력한 SLS(우주 발사 시스템) 로켓에 의해 우주로 운반되는 Orion 우주선 내부에서 발사됩니다.

승무원은 우주에서 10일을 보내며 먼저 지구 주위를 비행한 다음 달 주위를 비행한 후 스플래시다운 착륙을 위해 돌아올 것입니다.

많은 기대를 모았던 이번 임무는 50여년 전 마지막 아폴로 임무 이후 인간을 위한 최초의 달 탐사 비행입니다.

NASA의 비디오는 발사부터 착륙까지 임무의 모든 단계를 보여줍니다.

"10일간의 시험 비행은 승무원들과 함께 다양한 심우주 탐사 능력을 보여줄 것입니다."라고 내레이터는 말합니다. "이 임무는 오리온 우주선이 우주비행사를 깊은 우주에서 살려둘 준비가 되어 있음을 증명하고 승무원과 지상 팀이 향후 임무 성공에 필수적인 작업을 연습할 수 있도록 해줄 것입니다."

임무에는 달 착륙이 포함되지 않습니다. 대신 4명의 우주비행사는 달 주위를 비행하면서 달 표면에서 6,500~9,500km(4,000~6,000마일) 이내에 접근하게 됩니다.

우주선이 달의 반대편에서 돌아오면서 4일 동안 지구의 대기에 이끌려 집으로 돌아오게 됩니다.

귀환의 마지막 단계에서 오리온과 승무원은 시속 약 25,000마일(시속 약 40,000km)의 속도로 지구 대기권에 진입하게 됩니다.

지구 대기와의 마찰과 낙하산 배치로 인해 캘리포니아 해안선에서 약 50마일 떨어진 곳에서의 물보라에 대비하여 하강 속도가 느려질 것입니다.

NASA는 현재 로켓에 대한 최종 점검을 진행하고 있으며, 이번 주말에 젖은 드레스 리허설이 있을 것으로 예상됩니다. 한편 승무원들은 이제 일생일대의 여행을 참을성 있게 기다리며 격리되어 있습니다.

PR -

AI 챗봇은 얼마나 자주 사용자를 위험한 경로로 유도합니까?

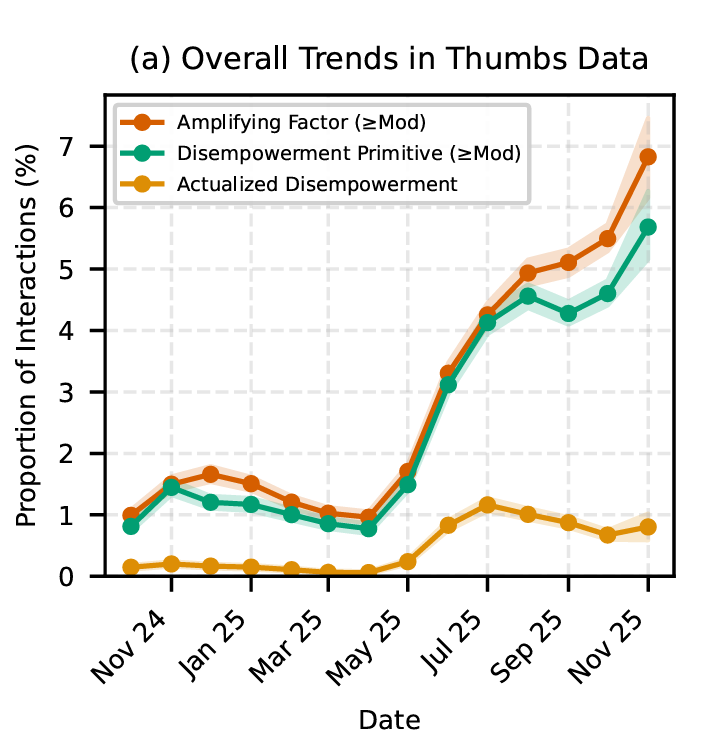

이러한 최악의 결과는 비례적으로 상대적으로 드물지만 연구원들은 "AI를 사용하는 사람의 수와 사용 빈도를 고려할 때 매우 낮은 비율이라도 상당한 수의 사람들에게 영향을 미친다"고 지적합니다. 그리고 권한 박탈의 유형에 따라 대화 50분의 1에서 70분의 1 사이에서 발생한 최소한 "경미한" 권한 박탈 가능성이 있는 대화를 고려하면 그 수치는 훨씬 더 악화됩니다.

더욱이 Claude와의 대화를 무력화시킬 가능성은 2024년 말부터 2025년 말 사이에 크게 증가한 것으로 보입니다. 연구원들은 이러한 증가의 단일 이유를 밝힐 수는 없었지만, AI가 대중화되고 사회에 통합됨에 따라 사용자가 "취약한 주제에 대해 논의하거나 조언을 구하는 것이 더 편안해지기" 때문일 수 있다고 추측했습니다.

Claude의 응답을 잠재적으로 "무력화"하는 문제는 시간이 지남에 따라 더욱 악화되는 것 같습니다.

Claude의 응답을 잠재적으로 "무력화"하는 문제는 시간이 지남에 따라 더욱 악화되는 것 같습니다.

크레딧: Anthropic

사용자 오류?

연구에서 연구원은 클로드 대화 텍스트 연구는 "확인된 피해보다는 무력화 가능성"만을 측정하며 "본질적으로 주관적인 현상에 대한 자동화된 평가에 의존한다"는 점을 인정했습니다. 이상적으로 그들은 향후 연구에서 사용자 인터뷰나 무작위 대조 시험을 활용하여 이러한 피해를 보다 직접적으로 측정할 수 있다고 썼습니다.

그렇긴 하지만, 이 연구에는 대화 내용이 실제 피해를 분명히 암시하는 몇 가지 문제가 되는 사례가 포함되어 있습니다. Claude는 때때로 격려(예: "확인됨", "정확히", "100%")를 통해 "추측적이거나 위조할 수 없는 주장"을 강화했으며, 이로 인해 어떤 경우에는 사용자가 "현실과 동떨어진 점점 더 정교한 서술을 구축"하게 되었습니다.

Claude의 격려는 사용자가 "대립 메시지를 보내거나, 관계를 끝내거나, 공개 발표 초안을 작성"하는 결과를 가져올 수도 있다고 연구진은 썼습니다. AI가 작성한 메시지를 보낸 사용자들은 나중에 클로드와의 대화에서 “내가 아니었어”, “네가 나에게 멍청한 짓을 하게 만들었어” 등의 표현을 사용하며 후회를 표현하는 경우가 많았다.

-

이 작은 USB-C 마이크는 전문적으로 녹음된 휴대폰 비디오 사운드를 만드는 가장 쉬운 방법입니다.

ZDNET의 주요 시사점

- Shure MV88 USB-C는 160달러에 구입할 수 있습니다.

- 오디오 녹음에 전문적인 레이어를 추가하려는 모든 사람에게 초보자 친화적인 옵션입니다.

- 스마트폰으로만 녹음하는 사람들에게 가장 적합합니다.

더 많은 구매 선택

ZDNET을 팔로우하세요: 우리를 선호 소스로 추가하세요 Google에서.

브이로그나 소셜 미디어 비디오를 위해 휴대폰을 사용하지만 내장 마이크가 비디오 품질을 저하시킨다면 업그레이드가 필요할 수 있습니다. 슈어의 MV88 USB-C 저렴한 미니 핀 마이크보다 더 많은 사용자 정의 기능을 제공하는 사용하기 쉬운 솔루션을 원한다면 훌륭한 옵션입니다.

추가 정보: 작은 마이크 하나로 가장 큰 비디오 제작 문제를 해결한 방법

그러나 멀리서도 작동하는 마이크를 찾고 있다면 이 마이크는 그렇지 않습니다. MV88 USB-C는 휴대폰의 마이크를 쉽게 업그레이드하여 녹음의 오디오 레벨을 일관되게 유지하면서 배경 소음을 줄입니다. 160달러에는 더 저렴한 옵션이 있지만 동일한 생산 기능을 제공하지 않을 수도 있습니다. 구매하기 전에 알아야 할 사항은 다음과 같습니다.

MV88 USB-C는 내 손바닥만한 크기이므로 사용하지 않을 때는 가방에 넣거나 주머니에 휴대하기 쉽습니다. MV88을 스마트폰의 포트에 연결하고 녹음을 시작할 수 있습니다. 또한 오디오 녹음에는 음성, 노래, 플랫, 어쿠스틱, 큰 소리 등 5가지 오디오 사전 설정이 있습니다.

이러한 사전 설정은 사용자 정의할 수 있지만 저는 원래 설정을 고수했습니다. 저는 음성 해설을 녹음하기 위해 음성 모드를 사용했는데, 이는 녹음 시 홈 오피스 히터의 실내 톤을 최소화하는 데 특히 도움이 되었습니다.

추가 정보: YouTube 동영상을 무료로 다운로드하는 방법 - 쉽고 안정적인 2가지 방법

또한 올해 CES에서 일일 브이로그를 녹화하면서 MV88의 자동 레벨 모드를 사용했는데, 이 기능은 마이크의 게인이나 감도를 안정화할 수 있는 기능입니다. 실시간 노이즈 제거 기능과 결합된 이 기능을 사용하면 많은 군중이 내 오디오를 방해하는 주변 소음에 대해 걱정할 필요가 없습니다.

제이다 존스/ZDNET MV88로 녹음하고 라스베거스 스트립의 거리를 걷는 동안 경적을 울리는 자동차 소리가 마이크의 오디오 기능에 포함되었지만 내 목소리를 산만하게 하기보다는 내 녹음에 색을 더할 만큼 충분히 감쇠되었습니다.

마이크의 극성 패턴 및 오디오 캡처 방향 조정을 포함하여 이러한 모든 기능은 Shure Motiv 앱에서 전환할 수 있습니다. MV88은 후면 및 측면 오디오에 덜 중점을 두고 마이크 바로 앞에서 오디오를 녹음하는 모노 카디오이드 패턴을 특징으로 합니다. 이 픽업 패턴은 브이로그 스타일의 녹화에 가장 유용하기 때문에 여기서 벗어나지 않았습니다.

또한: 고품질 YouTube 동영상을 만들기 위한 9가지 필수 도구

Shure Motiv 앱은 휴대폰에서 MV88을 분리하더라도 선호하는 마이크 설정을 저장하므로 녹음할 때마다 설정을 조작할 필요가 없습니다.

MV88의 유일한 제한은 녹음할 때 휴대폰에 테더링되어야 한다는 것입니다. 인터뷰를 진행하는 경우 양방향 픽업 패턴을 사용하고 인터뷰 대상자와 비교적 가까이 서 있어야 합니다. 무선 마이크나 원격 녹음에 적합한 장치를 원한다면 MV88은 적합하지 않습니다.

ZDNET의 구매 조언

그만큼 슈어 MV88 USB-C 마이크는 신진 콘텐츠 제작자나 동영상을 만드는 모든 사람을 위한 매우 간단하고 초보자 친화적인 솔루션입니다. 휴대폰에 내장된 스피커를 통한 오디오 녹음 성능이 크게 향상되고 더 많은 사용자 정의가 가능해 비디오에 전문성을 더할 수 있습니다. 더욱이, 마이크는 무게를 줄이지 않고도 주머니나 가방에 쉽게 들어갈 수 있습니다.

그러나 MV88 USB-C는 스마트폰으로만 촬영하고 브이로그 스타일의 동영상을 선호하는 사람들에게만 적합한 솔루션입니다. 무선기기가 아니며, 멀리서 깨끗한 오디오를 캡쳐하려고 하면 성능이 크게 저하됩니다.

대부분의 비디오를 휴대폰으로 촬영하는 것 이상으로 업그레이드하여 더 이상 직접 대화할 수 없다면 고급 옵션을 고려해 보세요.

-

誰もがこれらのスマートホーム用語を理解する必要があります

ほとんどのスマート ホーム用語は一目瞭然ですが、専門用語に詳しくない初心者にとってはわかりにくい用語がたくさんあります。そこで、ここでは、遭遇する可能性のある最も一般的なスマートホーム用語とその意味をまとめた用語集を紹介します。

ハブ、サーバー、ゲートウェイ

すべてのスマート ホーム システムには、一般にハブ (Google Home や Apple Home などの独自システムの場合) またはサーバー (Home Assistant の場合) と呼ばれる、ある種の中央コントローラーが必要です。ゲートウェイという用語も使用されることがあります。

ハブの例には、Apple の HomePod mini や Amazon の Echo Hub などがあります。 Home Assistant Green は、特定のエコシステム向けのターンキー サーバー ソリューションです。

エコシステムまたはプラットフォーム

エコシステムまたはプラットフォームは、スマート ホームを実行する基盤となるハードウェアとソフトウェアを指します。エコシステムの選択は、多くの場合、既に所有しているデバイス、優先順位、技術スキルの点でどれだけ快適であるかによって決まります。

たとえば、Apple Home は、iPhone を使用し、ローカル制御の利点があるものの、ネイティブの Android 統合がない家庭に適している可能性があります。 Google Home と Amazon Alexa はあらゆるブランドのスマートフォンでうまく動作しますが、クラウドへの依存度が高くなります。ホーム アシスタントはおそらく最もオープンで強力な選択肢ですが、セットアップとメンテナンスにはもう少し作業が必要です。

オートメーション

オートメーションは、トリガーに従って実行される一連のアクションです。これは、設定した時間に照明を点灯したり、誰かが帰宅するたびに一連のデバイス全体を起動したりするのと同じくらい簡単です。自動化は、ボタンを押して結果を確認するなどの手動アクションを指すこともあります。

自動化という用語は、より広範な記述子としても使用され、必ずしも単一の一連のアクションのみを指すわけではありません。たとえば、「自動化はスマート ホームの最終目標です」などです。

シーンと気分

シーン (ムードとも呼ばれます) を使用すると、複数のデバイスを一度にすばやくトリガーして、選択した状態にすることができます。たとえば、メインの照明を消し、再生中の音楽を一時停止し、色付きのバイアス照明をオンにし、テレビの電源をオンにする「映画」シーンがあるとします。

音声アシスタント

音声アシスタントを使用すると、ウェイクワードやコマンドでスマートホームやその他のデバイスを制御できます。音声アシスタントには通常、ハブとしても機能するスマート スピーカーが必要です。例としては、Amazon デバイスの Alexa、Nest デバイスの Google アシスタントと Gemini、Apple デバイスの Siri などがあります。

ホーム アシスタントには、ローカルで実行できる専用のハードウェアを備えた独自の音声アシスタントもあります。

案件

Matter は、すべての主要なスマート ホーム プラットフォーム (Google、Amazon、Apple、Samsung) が何らかの方法で採用しているスマート ホーム標準です。その考えは、エコシステム間の相互運用性を促進し、デバイス メーカーがさまざまなプラットフォームで動作するデバイスを製造できるようにすることです。ホーム アシスタントは Matter とも連携します。

Matter の唯一の問題は、標準が進化しており、メーカーごとに新しいバージョンを採用する割合が異なる傾向があることです。

メッシュネットワーク

スマート ホーム用語では、メッシュ ネットワークは Wi-Fi とは別に動作するワイヤレス ネットワークです。これらは低電力ネットワークであるため、ボタン、リモコン、センサーなどのバッテリー駆動のデバイスに最適です。壁スイッチなどの受電装置は通常、リピータ ノードとして機能し、ネットワークの範囲をさらに拡張します。

プロトコル

プロトコルはテクノロジーの世界ではさまざまな用途に使用されますが、スマート ホームでは通常、さまざまな通信方法を指します。これを、通信に異なるプロトコルを使用する可能性がある Matter のような標準と混同しないでください。

スレッド、Zigbee、Z-Wave

Thread、Zigbee、Z-Wave は、スマート ホームを構築するときに遭遇する可能性が高い 3 つの主要なメッシュ ネットワーク プロトコルです。 Thread はこれらの中で最も新しいもので、Matter デバイスによってよく使用されます (ハブとして機能するには Thread Border Router が必要です)。

Zigbee と Z-Wave は通常、独自のシステムまたはホーム アシスタントで使用され、専用の無線が必要です。

リレー

リレーは、主電源と制御するデバイスの間に配置されるコントローラーです。これは、(愚かな) 照明のスイッチやソケットである可能性があります。あるいは、電気スペース ヒーターのような配線されたデバイスである可能性もあります。スイッチをバイパスしてデバイスを直接制御できるため、照明を暗くするなどの操作が可能になります。

トリガーとイベント

トリガー (イベントとも呼ばれます) は、通常はオートメーションを開始するアクションです。例としては、ボタンを押す、センサーが動きを記録する、誰かが帰宅する、時刻などが挙げられます。

条件

スマート ホーム オートメーションでは、条件はワークフローの設計時に使用できる追加のチェックです。すべてのスマート ホーム システムが条件をサポートしているわけではありませんが、多くのシステム (ホーム アシスタントや Google Home など) はサポートしています。

ワークフローで条件を使用して、時刻や明るさのレベルなどの基準を満たすことができます。ホーム アシスタントでは、状況に応じてさまざまなアクションを実行する、より複雑なオートメーションを構築できます。

センサー

センサーは、受動的赤外線モーション センサーや大気質メーターなど、環境内の何かを測定したり状態の変化を記録したりする受動的デバイスです。自動化を設計するときに、センサーを使用してアクション (動きなど) をトリガーしたり、条件 (室内に継続的に存在するなど) を満たしたりすることができます。また、温度など、一目で知りたいデータを収集するのにも便利です。

また、3D プリントの一般的な用語の用語集も作成しました。これらの用語についても理解したい場合は、こちらをご覧ください。

-

Google의 Project Genie를 사용하면 나만의 대화형 세계를 생성할 수 있습니다.

지난 여름, Google DeepMind는 Genie 3를 선보였습니다. 이것은 소프트웨어가 시뮬레이션하는 환경에서 사용자가 움직일 때 이미지를 생성하고 반응할 수 있는 AI 시스템인 세계 세계로 알려진 것입니다. 당시 DeepMind는 Genie 3를 AI 에이전트 교육용 도구로 포지셔닝했습니다. 이제 Google 외부의 사람들도 Project Genie를 사용해 볼 수 있도록 모델을 제공하고 있습니다.

시작하려면 Project Genie를 확인하려면 Google의 월 250달러 AI Ultra 요금제가 필요합니다. 또한 미국에 거주하고 18세 이상이어야 합니다. 출시 시 Project Genie는 세계 스케치, 탐색, 리믹싱이라는 세 가지 상호 작용 모드를 제공합니다. 첫 번째는 Genie 3가 나중에 탐색할 세계를 만드는 데 사용할 소스 이미지를 생성하는 Google의 Nano Banana Pro 모델을 보여줍니다. 이 단계에서는 캐릭터를 설명하고, 1인칭, 3인칭, 등각 투영 등 카메라 관점을 정의하고 Genie 3가 생성하려는 세계를 탐색하는 방법을 정의할 수 있습니다. 모델 생성을 시작하기 전에 Nano Banana Pro는 사용자가 보려고 하는 내용을 "스케치"하여 조정할 수 있습니다. 다른 사람들이 Genie를 사용하여 생성한 세계에 대한 프롬프트를 직접 작성하는 것도 가능합니다.

한 가지 명심해야 할 점은 지니 3는 게임 엔진이 아니라는 점입니다. 출력은 게임처럼 보일 수 있고 물리적 상호 작용을 시뮬레이션할 수 있지만 여기에는 전통적인 게임 메커니즘이 없습니다. 세대도 60초로 제한되며 프레젠테이션도 초당 24프레임, 720p로 제한됩니다. 그럼에도 불구하고 AI Ultra 구독자라면 DeepMind가 지난 몇 년 동안 작업해 온 최첨단 기능을 볼 수 있는 멋진 기회입니다.